Unsloth

Outil IA orienté fine-tuning accéléré de LLM, visant à réduire le temps d’entraînement et l’usage mémoire pour des modèles open-source.

La plateforme et ses composants se concentrent sur la performance (vitesse d’entraînement, VRAM, stabilité), la reproductibilité (pipelines réutilisables) et l’industrialisation (itération rapide sur datasets, prompts, évaluations). Dans un contexte 2024–2025 où les entreprises cherchent à réduire leurs coûts d’API et à améliorer la précision sur des cas d’usage spécifiques, Unsloth se positionne comme une brique pragmatique pour produire des modèles spécialisés, exploitables en production.

L’outil est particulièrement pertinent pour : assistants internes, agents métier, chatbots spécialisés, classification, extraction, génération contrôlée, et scénarios où la qualité “métier” prime sur la généralité. Unsloth s’insère naturellement dans un workflow IA moderne : préparation des données, fine-tuning, évaluation, export, puis déploiement via une infra d’inférence.

Comment utiliser Unsloth ?

- Choisir un modèle open-source compatible et un objectif métier clair.

- Préparer un dataset (instructions, Q/R, conversations) et définir les règles de qualité.

- Lancer le fine-tuning avec les paramètres recommandés (batch, epochs, contraintes mémoire).

- Évaluer sur un jeu de tests et comparer les métriques (qualité, format, robustesse).

- Ajuster les données / hyperparamètres, puis relancer pour itérer rapidement.

- Exporter le modèle et l’intégrer dans une API d’inférence ou un agent applicatif.

Analyse détaillée

Unsloth s’inscrit dans la vague 2024–2025 de “LLM pragmatiques” : réduire les coûts, augmenter la précision métier, et industrialiser l’itération. Son avantage principal est l’optimisation performance/mémoire, particulièrement utile quand les ressources GPU sont contraintes. En contrepartie, la valeur d’Unsloth dépend fortement de la qualité des données d’entraînement et de la maturité MLOps : sans dataset propre et objectifs mesurables, le fine-tuning peut dégrader la qualité. Positionnement : excellent choix pour équipes techniques souhaitant produire des modèles spécialisés, plus contrôlables, et potentiellement moins coûteux à servir que des API généralistes.

Fonctionnalités & Cas d’usage

- Fine-tuning accéléré — Réduction significative du temps d’entraînement pour itérer plus vite.

- Optimisation mémoire — Diminution de la VRAM nécessaire, utile sur GPU plus modestes.

- Orientation LLM open-source — Adaptation de modèles populaires selon les besoins.

- Workflows reproductibles — Paramètres et pipelines réutilisables pour équipes et projets.

- Support de jeux de données — Itération rapide sur datasets de conversation et d’instruction.

- Contrôle des objectifs — Ajustement du comportement du modèle (ton, format, style, contraintes).

- Qualité métier — Meilleure précision sur un domaine spécifique que des modèles génériques.

- Export pour déploiement — Sorties prêtes à être servies via une couche d’inférence.

- Approche développeur — Pensé pour des équipes techniques (MLOps, AI engineers).

- Assistant métier spécialisé — Ajuster un LLM aux procédures internes et au vocabulaire d’entreprise.

- Support client — Améliorer la pertinence et la cohérence des réponses sur une base documentaire.

- Classification — Catégorisation de tickets, emails, formulaires et demandes entrantes.

- Extraction d’informations — Structurer des données depuis textes non structurés.

- Rédaction contrôlée — Génération conforme à une charte (style, ton, formats attendus).

- Agents IA — Modèles plus fiables sur un domaine, réduisant hallucinations et dérives.

- Produit SaaS IA — Différenciation par modèle spécialisé et coût d’inférence réduit.

Intégrations

- Python (pip / notebooks)

- Hugging Face (datasets & modèles)

- PyTorch / CUDA (environnement GPU)

- Export vers moteurs d’inférence (workflow)

- Intégration MLOps (CI/CD, registry, monitoring)

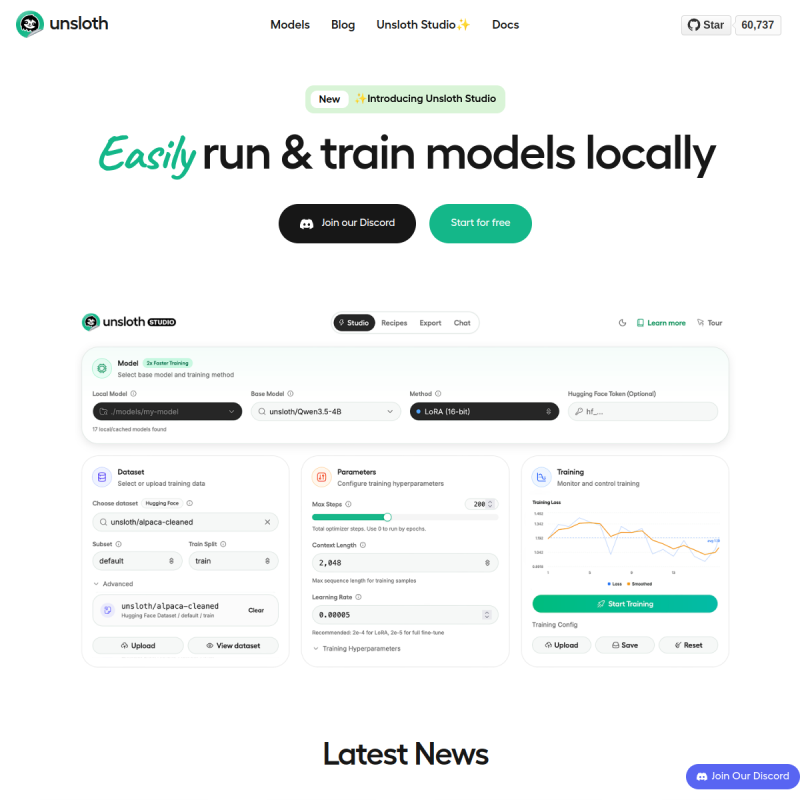

Screenshots

Tarification

- Gratuit : Démarrage, tests et expérimentation sur des usages limités.

- Pro : Fonctionnalités avancées, meilleure performance et options orientées production.

- Entreprise : Support, sécurité, workflows sur mesure et accompagnement MLOps.

Avantages & Limites

👍 Avantages

- Fine-tuning plus rapide et itératif

- Réduction de la consommation VRAM

- Très pertinent pour modèles spécialisés métier

- S’intègre bien dans un workflow MLOps

👎 Limites

- Nécessite données de qualité et compétences techniques

- Résultats variables selon dataset et objectifs

- Pas orienté utilisateurs non techniques

Alternatives

- Axolotl

- Hugging Face AutoTrain

- OpenPipe

- Lamini

🔍 Outils similaires

Langfuse

Plateforme open-source d’observabilité, d’analytique et d’évaluation pour applications et agents basés sur des LLM.

Flowise

Plateforme open-source no-code permettant de créer des workflows LLM, chatbots et agents IA via une interface visuelle.

HoneyHive

Plateforme d’observabilité et de monitoring pour applications et agents basés sur des modèles de langage.

LangWatch

Plateforme de monitoring, d’évaluation et d’amélioration continue de la qualité des applications basées sur des LLM.

LM Studio

Application desktop permettant d’exécuter des modèles de langage localement sur sa machine, sans dépendance cloud.

Invariant AI

Plateforme de sécurité et de guardrails pour applications et agents basés sur des modèles de langage.