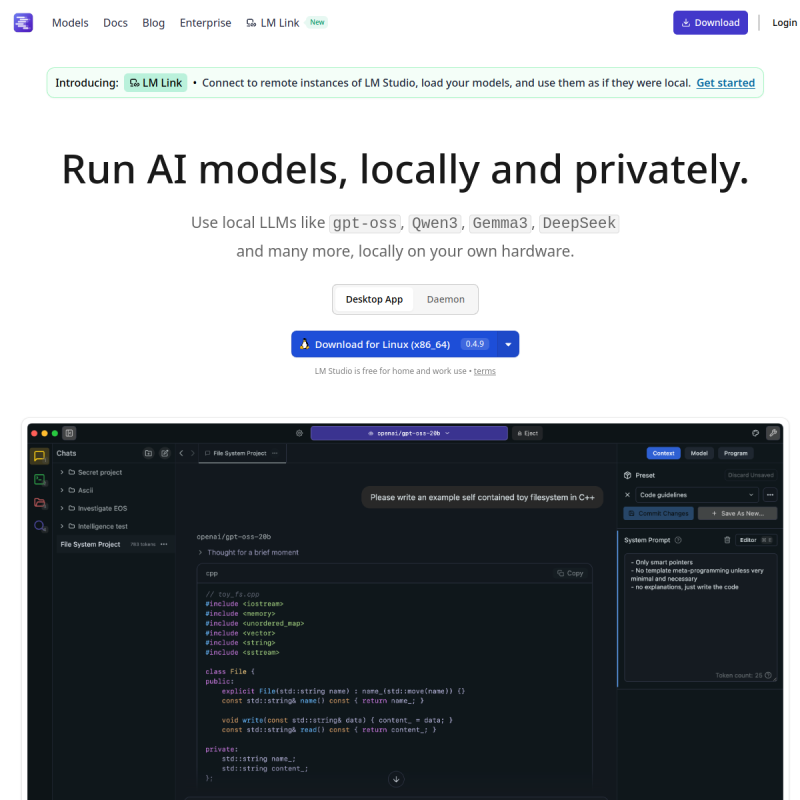

LM Studio

Application desktop permettant d’exécuter des modèles de langage localement sur sa machine, sans dépendance cloud.

L’outil s’adresse aussi bien aux développeurs qu’aux utilisateurs avancés souhaitant explorer des LLM sans infrastructure complexe. Il permet d’exécuter des modèles quantifiés adaptés aux ressources locales (CPU ou GPU), de gérer plusieurs modèles, et d’exposer une API locale compatible avec des applications existantes. LM Studio est souvent utilisé comme environnement de test, de prototypage ou comme backend local pour des agents IA, assistants personnels et outils internes sensibles.

Comment utiliser LM Studio ?

- Télécharger et installer LM Studio.

- Choisir et télécharger un modèle compatible.

- Lancer le modèle en local.

- Tester via l’interface chat.

- Optionnellement exposer l’API locale.

Analyse détaillée

LM Studio s’impose comme une solution très populaire pour l’exécution locale de LLM, en particulier auprès des développeurs et utilisateurs soucieux de confidentialité. Sa simplicité d’installation et son approche “tout-en-un” sont ses principaux atouts. En revanche, les performances dépendent fortement du matériel local et des modèles choisis, ce qui peut limiter certains usages intensifs.

Fonctionnalités & Cas d’usage

- Exécution locale de LLM — Les modèles tournent directement sur la machine de l’utilisateur.

- Interface desktop simple — Téléchargement et gestion des modèles en quelques clics.

- Support des modèles open-source — Compatibilité avec de nombreux LLM populaires.

- Quantisation automatique — Adaptation aux ressources CPU/GPU disponibles.

- Chat interactif — Tester et comparer les modèles via une interface conversationnelle.

- API locale — Exposition d’un endpoint compatible pour intégration applicative.

- Fonctionnement hors ligne — Pas de dépendance cloud pour l’inférence.

- Gestion multi-modèles — Passer d’un modèle à l’autre facilement.

- Prototypage LLM — Tester rapidement différents modèles en local.

- Protection des données — Cas d’usage sensibles sans envoi vers le cloud.

- Agents IA locaux — Backend local pour assistants personnels.

- Développement et tests — Validation avant déploiement cloud.

- Formation et apprentissage — Comprendre le fonctionnement des LLM.

Intégrations

- macOS

- Windows

- API locale HTTP

- Intégration outils dev locaux

Screenshots

Tarification

- Gratuit : Utilisation de base et exécution locale.

- Pro : Fonctionnalités avancées et options supplémentaires.

Avantages & Limites

👍 Avantages

- Exécution locale sans cloud

- Très simple à utiliser

- Bon contrôle des données

👎 Limites

- Dépend des ressources matérielles

- Moins adapté aux charges lourdes

Alternatives

- Ollama

- Text Generation WebUI

- LocalAI

🔍 Outils similaires

LlamaIndex

Framework open-source pour connecter des données privées aux modèles de langage via des pipelines RAG.

Guardrails AI

Framework open-source pour valider, sécuriser et contrôler les sorties des modèles de langage.

Promptfoo

Outil open-source pour tester, comparer et évaluer des prompts et configurations LLM de manière systématique.

Unsloth

Outil IA orienté fine-tuning accéléré de LLM, visant à réduire le temps d’entraînement et l’usage mémoire pour des modèles open-source.

Langfuse

Plateforme open-source d’observabilité, d’analytique et d’évaluation pour applications et agents basés sur des LLM.

Flowise

Plateforme open-source no-code permettant de créer des workflows LLM, chatbots et agents IA via une interface visuelle.