Instructor

Bibliothèque open-source permettant d’obtenir des sorties LLM strictement structurées et validées via des schémas.

Très populaire en 2024–2025 dans la communauté Python et backend, Instructor est souvent utilisé pour construire des APIs IA robustes, des agents fiables et des pipelines RAG exploitables. Sa philosophie est pragmatique : accepter que les LLM soient probabilistes, mais encadrer leur sortie par des contrats explicites et des validations automatiques. Cela permet aux équipes d’appliquer des standards d’ingénierie logicielle classiques (types, schémas, tests) à des systèmes génératifs.

Comment utiliser Instructor ?

- Installer Instructor via pip.

- Définir les schémas de sortie attendus.

- Appeler le LLM via Instructor.

- Valider automatiquement les réponses.

- Consommer les données côté application.

Analyse détaillée

Instructor est devenu un outil incontournable pour les équipes qui souhaitent intégrer les LLM de manière fiable en production. Sa simplicité et son efficacité en font une solution très appréciée pour éviter les erreurs classiques liées aux sorties non structurées. Il n’impose pas une architecture lourde, mais apporte une discipline essentielle. Sa limite principale réside dans la nécessité de concevoir des schémas précis et adaptés aux besoins métier.

Fonctionnalités & Cas d’usage

- Sorties structurées — Génération conforme à des schémas stricts.

- Validation automatique — Rejet et correction des formats invalides.

- Intégration Pydantic — Typage fort et validation Python native.

- Réduction des erreurs — Moins de parsing fragile côté application.

- Support multi-LLM — Compatible avec différents fournisseurs.

- Facilité d’adoption — Ajout minimal à un code existant.

- Idéal pour APIs IA — Réponses prévisibles et exploitables.

- Open-source — Communauté active et transparente.

- APIs IA — Garantir des réponses JSON fiables.

- Agents IA — État et actions structurés.

- RAG — Sorties conformes aux schémas attendus.

- Automatisation backend — Données directement consommables.

- Produits SaaS IA — Robustesse et maintenabilité.

Intégrations

- Python

- Pydantic

- OpenAI / Anthropic

- Frameworks backend

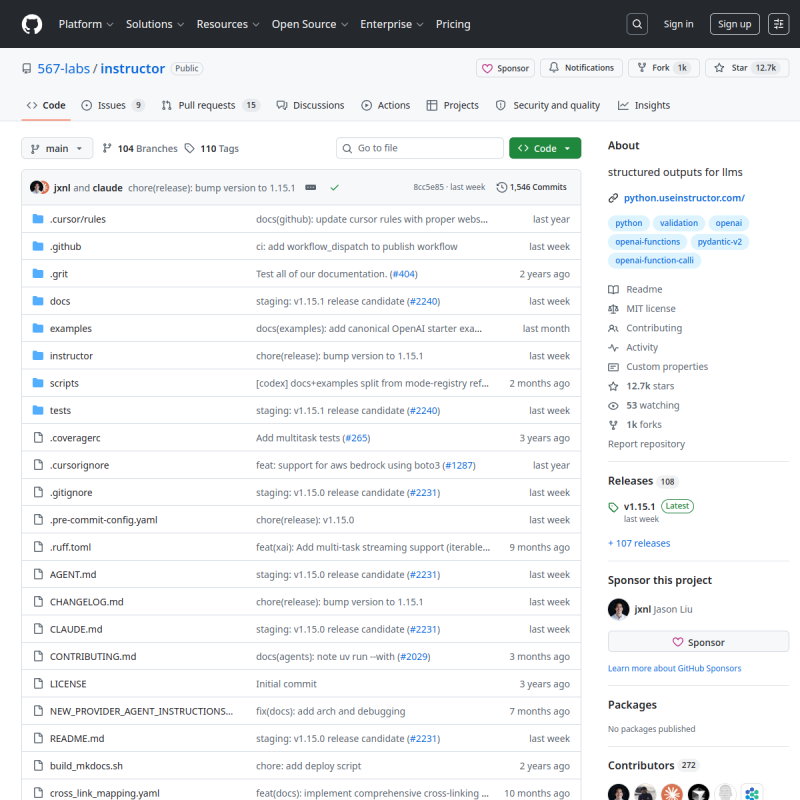

Screenshots

Tarification

- Open-source : Gratuit et libre d’utilisation.

- Support : Communauté et documentation.

Avantages & Limites

👍 Avantages

- Sorties LLM fiables et typées

- Très simple à intégrer

- Réduction drastique des erreurs de parsing

👎 Limites

- Nécessite définition de schémas

- Moins adapté à l’exploration libre

Alternatives

- PydanticAI

- BAML

- Guardrails AI

🔍 Outils similaires

PydanticAI

Framework Python moderne pour construire des agents IA fiables, typés et orientés production.

BAML by BoundaryML

Langage et runtime typés conçus pour produire des sorties LLM fiables, structurées et exploitables en production.

OpenPipe AI

Plateforme IA permettant d’entraîner, d’optimiser et de déployer des modèles de langage personnalisés pour des applications réelles.

Fireworks AI

Plateforme d’infrastructure IA permettant d’exécuter des modèles de langage et multimodaux avec des performances élevées et une faible la…

HoneyHive

Plateforme d’observabilité et de monitoring pour applications et agents basés sur des modèles de langage.

LangWatch

Plateforme de monitoring, d’évaluation et d’amélioration continue de la qualité des applications basées sur des LLM.