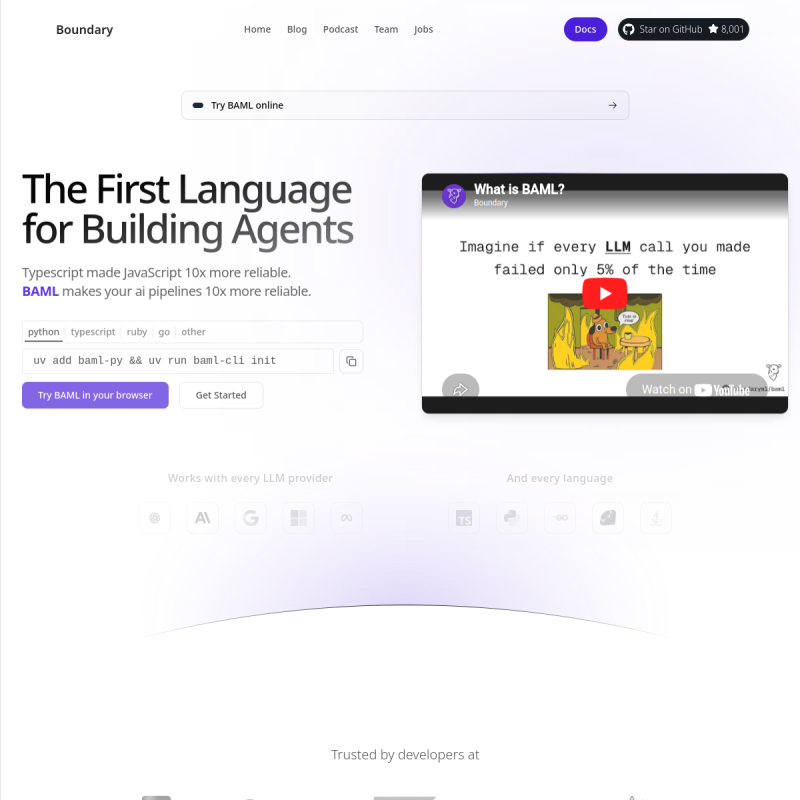

BAML by BoundaryML

Langage et runtime typés conçus pour produire des sorties LLM fiables, structurées et exploitables en production.

En pratique, BAML permet de définir des contrats clairs entre le développeur et le modèle de langage. Ces contrats sont ensuite compilés et exécutés via un runtime qui gère la génération, la validation et la correction automatique des sorties. Cela réduit fortement les erreurs de parsing, les formats imprévus et les hallucinations structurelles.

En 2024–2025, BAML est de plus en plus adopté par des équipes qui construisent des agents, des APIs IA ou des systèmes RAG en production et qui veulent appliquer des standards proches du développement logiciel classique (types, schémas, tests) au monde des LLM.

Comment utiliser BAML by BoundaryML ?

- Définir les types et structures attendues en BAML.

- Relier le contrat au prompt et au modèle.

- Exécuter via le runtime BAML.

- Valider automatiquement les sorties.

- Consommer les résultats côté application.

Analyse détaillée

BAML se positionne à l’intersection du prompt engineering et de l’ingénierie logicielle. Sa force est d’imposer une discipline structurelle là où les LLM sont naturellement permissifs. Il est particulièrement pertinent pour les systèmes critiques, agents complexes et APIs exposées. En contrepartie, il nécessite un changement de mentalité : penser en termes de contrats et de types plutôt qu’en prompts libres.

Fonctionnalités & Cas d’usage

- Langage typé pour LLM — Définition explicite des structures de sortie attendues.

- Validation automatique — Détection et correction des sorties non conformes.

- Réduction des hallucinations structurelles — Formats fiables et prévisibles.

- Runtime dédié — Gestion de l’exécution et de la validation.

- Contrats LLM — Accord clair entre logique métier et génération.

- Intégration backend — Sorties directement exploitables par le code.

- Support agents et RAG — Idéal pour pipelines complexes.

- Open-source — Transparence et extensibilité.

- APIs IA — Garantir des réponses JSON fiables.

- Agents IA — Réduire les erreurs de format et d’état.

- RAG — Sorties structurées pour citations et grounding.

- Automatisation métier — Résultats prévisibles et testables.

- SaaS IA — Robustesse en production.

Intégrations

- LLM providers (selon configuration)

- Backends TypeScript / Python

- APIs internes

- Pipelines agents

Screenshots

Tarification

- Open-source : Utilisation libre.

- Enterprise : Support et accompagnement BoundaryML.

Avantages & Limites

👍 Avantages

- Sorties LLM strictement structurées

- Réduction massive des erreurs de parsing

- Très adapté à la production

👎 Limites

- Courbe d’apprentissage conceptuelle

- Moins flexible pour l’exploration libre

Alternatives

- PydanticAI

- Instructor

- Guardrails AI

🔍 Outils similaires

Instructor

Bibliothèque open-source permettant d’obtenir des sorties LLM strictement structurées et validées via des schémas.

Dify

Plateforme open-source pour créer, déployer et gérer des applications LLM, agents IA et workflows RAG.

LangFlow

Outil open-source no-code pour concevoir visuellement des workflows LLM et applications basées sur LangChain.

LangSmith

Plateforme d’observabilité et de débogage pour applications LLM, agents IA et pipelines RAG.

PydanticAI

Framework Python moderne pour construire des agents IA fiables, typés et orientés production.

Rivet AI

Éditeur visuel pour concevoir, tester et maintenir des workflows LLM complexes sans perdre le contrôle technique.