Axolotl

Framework open-source dédié au fine-tuning avancé de modèles de langage open-source.

En 2024–2025, Axolotl est devenu une référence parmi les ingénieurs ML et chercheurs qui souhaitent un contrôle fin sur leurs pipelines de fine-tuning. Il est particulièrement apprécié pour sa compatibilité avec Hugging Face, ses options LoRA/QLoRA et sa capacité à s’adapter à des environnements GPU variés.

Comment utiliser Axolotl ?

- Installer Axolotl.

- Configurer le fichier YAML.

- Préparer le dataset.

- Lancer le fine-tuning.

- Évaluer le modèle.

Analyse détaillée

Axolotl s’adresse à des équipes techniques recherchant un contrôle maximal sur le fine-tuning de leurs LLM. Sa puissance et sa flexibilité en font un outil de choix pour des projets avancés, au prix d’une courbe d’apprentissage plus élevée.

Fonctionnalités & Cas d’usage

- Fine-tuning avancé — Configuration détaillée des entraînements.

- Support LoRA / QLoRA — Optimisation mémoire.

- Compatibilité Hugging Face — Modèles et datasets.

- Multi-GPU — Scalabilité locale ou cluster.

- Open-source — Transparence totale.

- LLM spécialisés — Domaines métiers précis.

- Recherche IA — Expérimentation contrôlée.

- Fine-tuning local — Maîtrise des données.

- Optimisation des coûts — GPU existants.

Intégrations

- Hugging Face

- PyTorch

- GPU NVIDIA

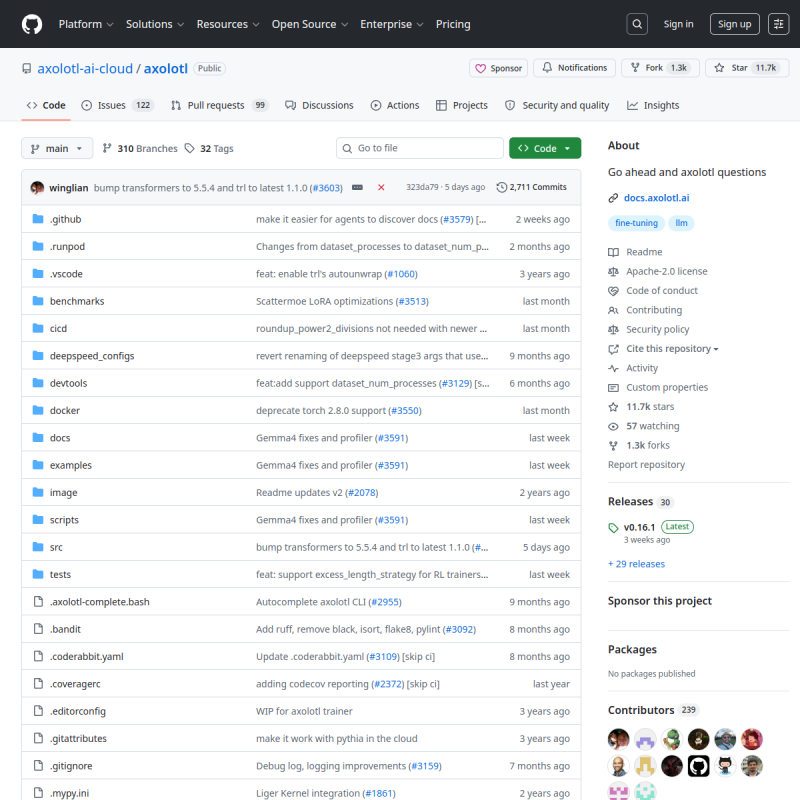

Screenshots

Tarification

- Gratuit : Projet open-source.

Avantages & Limites

👍 Avantages

- Contrôle fin du fine-tuning

- Open-source robuste

- Très flexible

👎 Limites

- Configuration complexe

- Réservé à un public technique

Alternatives

- Unsloth

- OpenPipe

- Together AI

🔍 Outils similaires

Unsloth

Framework de fine-tuning LLM ultra-rapide permettant d’entraîner des modèles open-source avec une efficacité mémoire et une vitesse accrues.

Together AI

Plateforme cloud permettant l’inférence et le fine-tuning de modèles de langage open-source à grande échelle.

Replicate

Plateforme permettant d’exécuter et de déployer des modèles de machine learning et de LLM via une API simple.

Modal

Plateforme serverless permettant d’exécuter des workloads IA, LLM et ML sans gérer d’infrastructure.

Paperspace

Plateforme de cloud GPU permettant le développement, l’entraînement et le déploiement de modèles ML et LLM.

LM Studio

Application desktop permettant d’exécuter des modèles de langage localement sur sa machine, sans dépendance cloud.