OpenSearch Vector Search

Fonctionnalités de recherche vectorielle intégrées à OpenSearch pour des architectures RAG open-source et enterprise.

En 2024–2025, OpenSearch est largement adopté comme alternative open-source à Elasticsearch pour construire des systèmes de recherche avancée et des pipelines RAG, notamment dans des environnements cloud et enterprise souhaitant éviter les contraintes de licences propriétaires.

Comment utiliser OpenSearch Vector Search ?

- Déployer OpenSearch.

- Créer des index vectoriels.

- Indexer les embeddings.

- Configurer la recherche hybride.

- Connecter un LLM.

Analyse détaillée

OpenSearch Vector Search constitue une alternative solide et ouverte pour les organisations souhaitant construire des solutions RAG enterprise sans dépendance à des licences propriétaires. Sa maturité et son écosystème cloud en font une option stratégique pour des architectures à long terme.

Fonctionnalités & Cas d’usage

- Recherche vectorielle — Similarité sémantique.

- Recherche hybride — Texte + embeddings.

- Open-source — Licence permissive.

- Scalabilité — Clusters distribués.

- Écosystème cloud — Support AWS.

- RAG enterprise — Données volumineuses.

- Recherche documentaire — Index hybrides.

- Assistants internes — Contexte métier.

- Alternatives Elastic — Open-source first.

Intégrations

- OpenAI

- Azure OpenAI

- LangChain

- LlamaIndex

- AWS OpenSearch Service

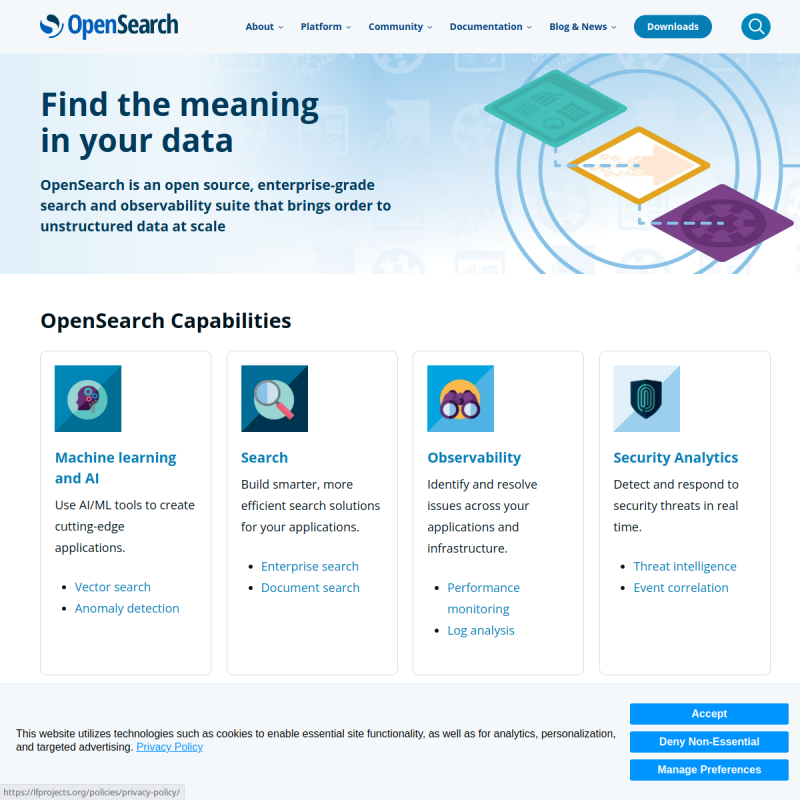

Screenshots

Tarification

- Gratuit : Open-source.

- Cloud : Service managé AWS payant.

Avantages & Limites

👍 Avantages

- Alternative open-source à Elasticsearch

- Recherche hybride puissante

- Bon support cloud

👎 Limites

- Configuration avancée

- Moins spécialisé que des vector DB dédiées

Alternatives

- Elasticsearch

- Weaviate

- Qdrant

🔍 Outils similaires

Elasticsearch Vector Search

Fonctionnalités de recherche vectorielle et sémantique intégrées à Elasticsearch pour des architectures RAG enterprise.

LlamaIndex

Framework permettant de connecter des modèles de langage à des données privées via des pipelines RAG (Retrieval-Augmented Generation).

Haystack

Framework open-source permettant de construire des systèmes de recherche, de question-réponse et de RAG basés sur des LLM.

Rebuff

Framework de sécurité permettant de détecter et bloquer les attaques de prompt injection sur les applications LLM.

Vectara

Plateforme RAG managée offrant une recherche sémantique de haute qualité et des réponses générées fiables.

Pinecone

Base de données vectorielle managée permettant de stocker, rechercher et servir des embeddings à grande échelle.