Chroma

Base de données vectorielle open-source simple d’utilisation pour applications LLM et pipelines RAG.

En 2024–2025, Chroma est largement utilisée pour le prototypage RAG, les projets de recherche et les premières mises en production d’assistants IA, notamment en combinaison avec LangChain et LlamaIndex.

Comment utiliser Chroma ?

- Installer Chroma.

- Créer une collection vectorielle.

- Indexer les embeddings.

- Effectuer des recherches.

- Intégrer avec un LLM.

Analyse détaillée

Chroma est idéale pour démarrer rapidement des projets LLM sans complexité infrastructure. Elle n’est toutefois pas conçue pour des charges très élevées ou des exigences enterprise avancées.

Fonctionnalités & Cas d’usage

- Vector database simple — API developer-friendly.

- Open-source — Déploiement local ou cloud.

- Intégration LLM — RAG rapide.

- Faible overhead — Démarrage immédiat.

- Écosystème populaire — Large adoption.

- Prototypage RAG — Tests rapides.

- Assistants IA légers — Données limitées.

- Recherche sémantique — Cas simples.

- Projets éducatifs — Apprentissage LLM.

Intégrations

- LangChain

- LlamaIndex

- OpenAI

- Hugging Face

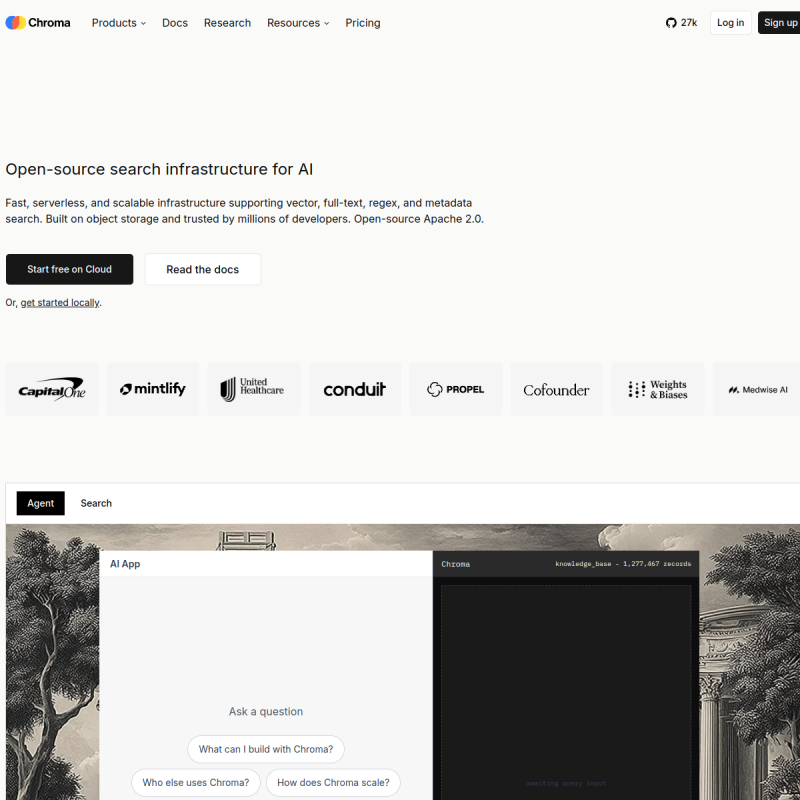

Screenshots

Tarification

- Gratuit : Open-source.

- Offres cloud : Services managés optionnels.

Avantages & Limites

👍 Avantages

- Très simple à utiliser

- Parfait pour prototypage

- Écosystème LLM fort

👎 Limites

- Limité pour très grande échelle

- Moins robuste que des solutions enterprise

Alternatives

- Pinecone

- Weaviate

- Qdrant

🔍 Outils similaires

Pinecone

Base de données vectorielle managée permettant de stocker, rechercher et servir des embeddings à grande échelle.

LlamaIndex

Framework permettant de connecter des modèles de langage à des données privées via des pipelines RAG (Retrieval-Augmented Generation).

Weaviate

Base de données vectorielle open-core permettant de stocker, rechercher et exploiter des embeddings pour des applications IA.

Qdrant

Base de données vectorielle open-source optimisée pour la recherche sémantique et les applications RAG.

Redis Vector Search

Moteur de recherche vectorielle intégré à Redis Stack pour des applications RAG et LLM à faible latence.

Langfuse

Plateforme d’observabilité dédiée aux applications LLM et aux agents IA.