Vectara

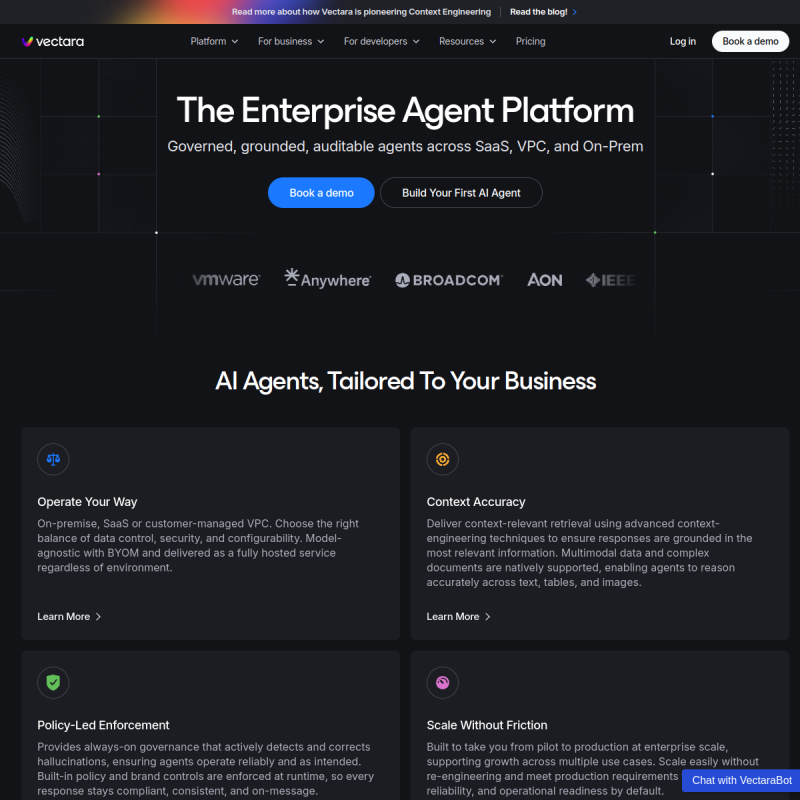

Plateforme RAG managée offrant une recherche sémantique de haute qualité et des réponses générées fiables.

En 2024–2025, Vectara est adoptée par des entreprises et des éditeurs SaaS souhaitant déployer rapidement des assistants IA fiables, sans avoir à construire et maintenir une stack RAG complexe (vector DB, ranking, reranking, orchestration).

Comment utiliser Vectara ?

- Créer un compte Vectara.

- Indexer les données.

- Configurer la recherche sémantique.

- Connecter le LLM.

- Déployer l’assistant IA.

Analyse détaillée

Vectara est particulièrement pertinent pour les équipes qui privilégient la fiabilité des réponses et la rapidité de mise en production. Son approche managée réduit fortement la complexité RAG, au prix d’une dépendance à une plateforme propriétaire.

Fonctionnalités & Cas d’usage

- RAG managé — Stack complète clé en main.

- Recherche sémantique avancée — Haute précision.

- Réduction des hallucinations — Retrieval optimisé.

- Scalabilité enterprise — Production-ready.

- API simple — Intégration rapide.

- Assistants IA sur données internes — Documentation, support.

- Recherche augmentée — Knowledge bases volumineuses.

- SaaS IA — RAG fiable sans complexité infra.

- IA entreprise — Cas critiques et réglementés.

Intégrations

- APIs Vectara

- LLM providers

- Connecteurs données

Screenshots

Tarification

- Essai : Accès limité.

- Payant : Tarification selon volume et usage.

Avantages & Limites

👍 Avantages

- RAG clé en main très fiable

- Réduction des hallucinations

- Production rapide

👎 Limites

- Solution propriétaire

- Moins flexible qu’une stack custom

Alternatives

- Pinecone

- Weaviate

- LlamaIndex

🔍 Outils similaires

LlamaIndex

Framework permettant de connecter des modèles de langage à des données privées via des pipelines RAG (Retrieval-Augmented Generation).

Haystack

Framework open-source permettant de construire des systèmes de recherche, de question-réponse et de RAG basés sur des LLM.

Pinecone

Base de données vectorielle managée permettant de stocker, rechercher et servir des embeddings à grande échelle.

Weaviate

Base de données vectorielle open-core permettant de stocker, rechercher et exploiter des embeddings pour des applications IA.

Qdrant

Base de données vectorielle open-source optimisée pour la recherche sémantique et les applications RAG.

Zilliz Cloud

Service cloud managé basé sur Milvus pour la recherche vectorielle et les architectures RAG en production.