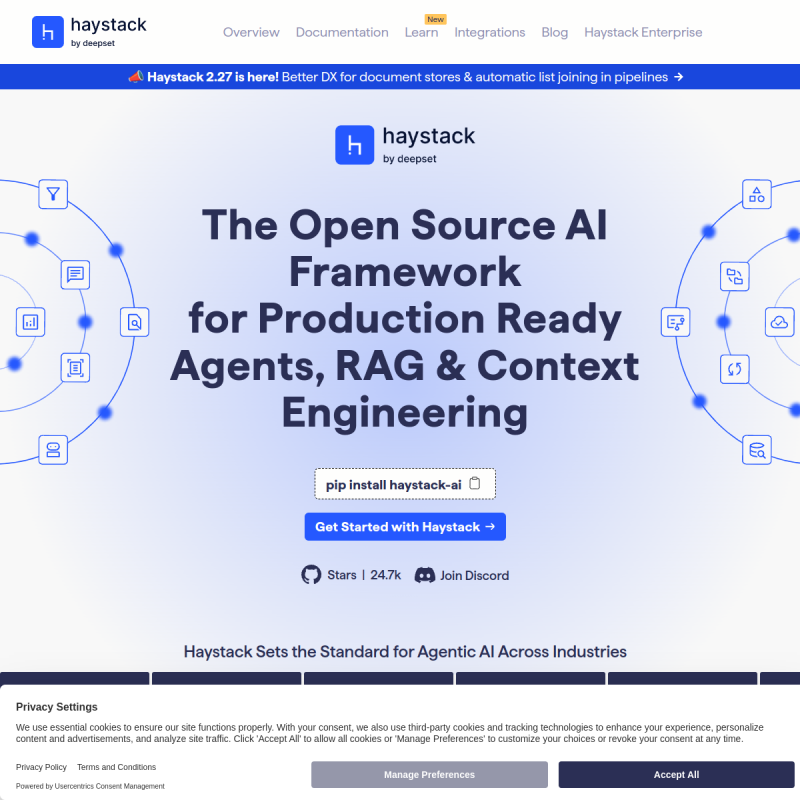

Haystack

Framework open-source permettant de construire des systèmes de recherche, de question-réponse et de RAG basés sur des LLM.

En 2024–2025, Haystack est largement utilisé dans des contextes professionnels et industriels où la fiabilité, la reproductibilité et la maîtrise des données sont critiques. Il est particulièrement apprécié pour les cas d’usage de recherche documentaire, d’assistants internes et de QA sur de grands volumes de documents.

Comment utiliser Haystack ?

- Installer Haystack.

- Configurer les sources de données.

- Indexer les documents.

- Connecter un LLM.

- Déployer le pipeline.

Analyse détaillée

Haystack est particulièrement adapté aux organisations recherchant une solution RAG robuste, explicable et maîtrisée. Sa conception modulaire et son orientation entreprise en font une alternative solide aux frameworks plus orientés expérimentation.

Fonctionnalités & Cas d’usage

- Pipelines RAG — Retrieval et génération combinés.

- Recherche sémantique — Texte non structuré.

- Question-réponse — QA sur documents.

- Architecture modulaire — Composants interchangeables.

- Open-source — Déploiement on-prem ou cloud.

- Recherche documentaire — Bases de connaissances.

- Assistants internes — Support et expertise.

- QA métier — Données réglementées.

- Applications RAG — Contexte fiable.

Intégrations

- OpenAI

- Hugging Face

- Elasticsearch

- FAISS

- Vector databases

Screenshots

Tarification

- Gratuit : Framework open-source.

- Entreprise : Support via deepset.

Avantages & Limites

👍 Avantages

- Très robuste en production

- Idéal pour QA documentaire

- Open-source mature

👎 Limites

- Moins orienté agents autonomes

- Configuration initiale plus lourde

Alternatives

- LlamaIndex

- LangChain

- Vectara

🔍 Outils similaires

LlamaIndex

Framework permettant de connecter des modèles de langage à des données privées via des pipelines RAG (Retrieval-Augmented Generation).

Vectara

Plateforme RAG managée offrant une recherche sémantique de haute qualité et des réponses générées fiables.

LangChain

Framework permettant de construire, orchestrer et déployer des applications LLM complexes basées sur des chaînes et des agents.

Pinecone

Base de données vectorielle managée permettant de stocker, rechercher et servir des embeddings à grande échelle.

Weaviate

Base de données vectorielle open-core permettant de stocker, rechercher et exploiter des embeddings pour des applications IA.

Qdrant

Base de données vectorielle open-source optimisée pour la recherche sémantique et les applications RAG.