Langfuse

Plateforme d’observabilité dédiée aux applications LLM et aux agents IA.

En 2024–2025, Langfuse est largement adoptée par les équipes développant des agents IA, des chatbots et des workflows LLM complexes, afin d’améliorer la fiabilité, la performance et la compréhension du comportement des modèles en environnement réel.

Comment utiliser Langfuse ?

- Installer le SDK Langfuse.

- Instrumenter les appels LLM.

- Déployer l’application.

- Analyser les traces.

- Optimiser prompts et coûts.

Analyse détaillée

Langfuse est devenu un outil clé pour professionnaliser les applications LLM. Sa spécialisation dans l’observabilité IA en fait une brique essentielle pour les équipes orientées production et agents complexes.

Fonctionnalités & Cas d’usage

- Tracing LLM — Suivi des requêtes et prompts.

- Observabilité agents — Workflows multi-étapes.

- Analyse des coûts — Suivi par modèle et usage.

- Dashboards — Visualisation temps réel.

- Open-source — Déploiement flexible.

- Applications LLM — Chatbots et assistants.

- Agents IA — Débogage et amélioration.

- Produits SaaS IA — Suivi qualité en production.

- Optimisation coûts — Analyse d’usage.

Intégrations

- OpenAI

- LangChain

- LlamaIndex

- APIs LLM

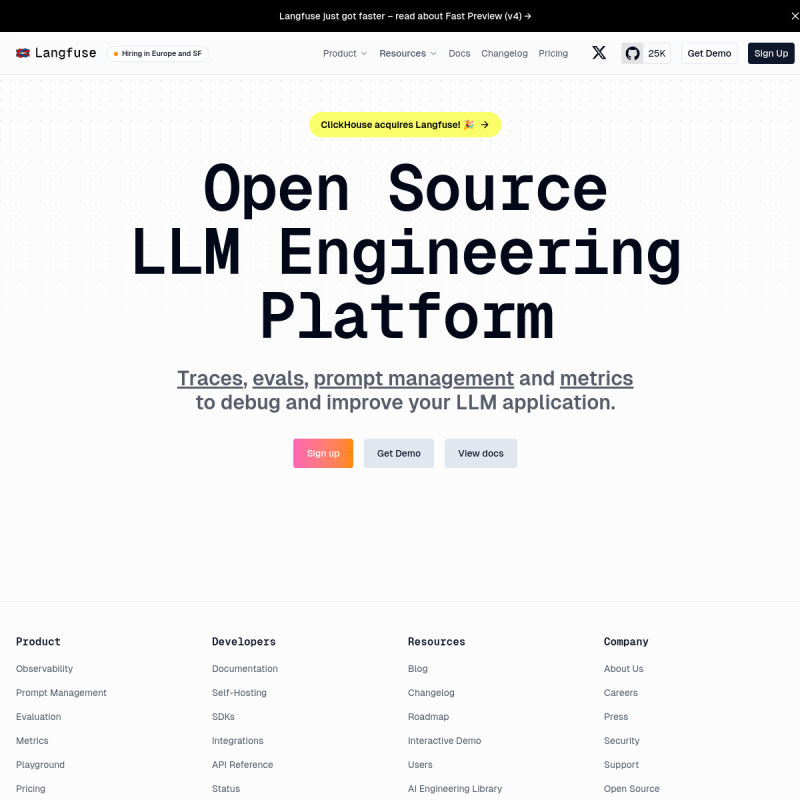

Screenshots

Tarification

- Gratuit : Usage limité.

- Pro : Selon volume et fonctionnalités.

Avantages & Limites

👍 Avantages

- Observabilité LLM native

- Open-source

- Très orienté production

👎 Limites

- Nécessite instrumentation

- Valeur surtout en prod

Alternatives

- Helicone

- PromptLayer

- Weights & Biases

🔍 Outils similaires

Helicone

Plateforme d’observabilité permettant de monitorer les coûts, la latence et la qualité des appels LLM.

PromptLayer

Plateforme de gestion, versioning et analyse de prompts pour applications basées sur des modèles de langage.

LangChain

Framework permettant de construire, orchestrer et déployer des applications LLM complexes basées sur des chaînes et des agents.

LlamaIndex

Framework permettant de connecter des modèles de langage à des données privées via des pipelines RAG (Retrieval-Augmented Generation).

Guardrails AI

Framework permettant de sécuriser, valider et contrôler les sorties des modèles de langage en production.

Chroma

Base de données vectorielle open-source simple d’utilisation pour applications LLM et pipelines RAG.