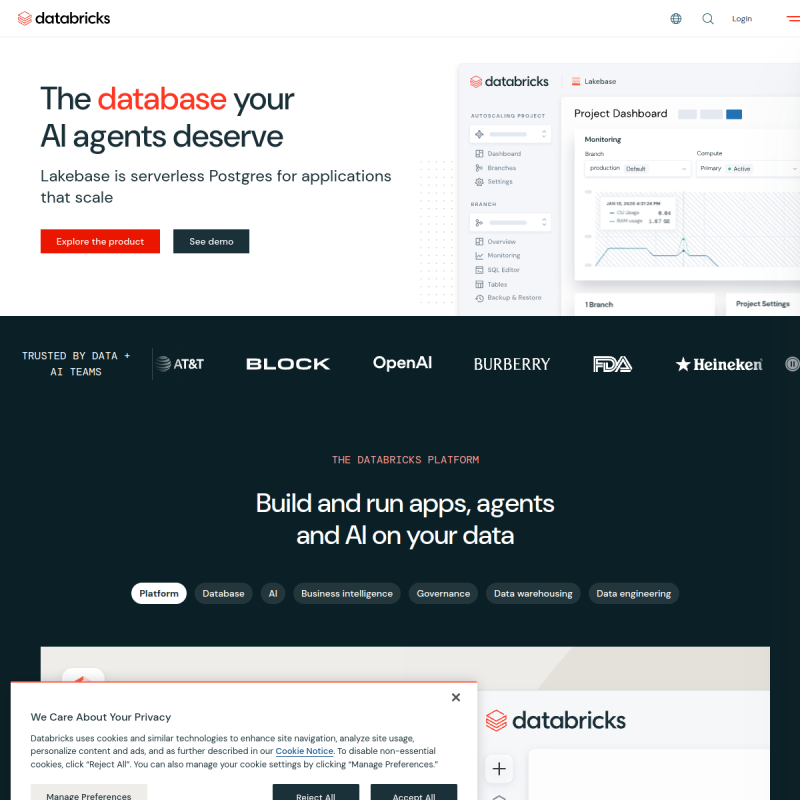

Databricks

Plateforme Lakehouse unifiée combinant data, MLOps et déploiement de modèles ML et LLM à l’échelle entreprise.

En 2024–2025, Databricks s’impose comme une brique centrale des stacks IA d’entreprise, notamment pour les cas d’usage LLM data-centric, le fine-tuning sur données internes et l’intégration avec des modèles open-source ou partenaires.

Comment utiliser Databricks ?

- Configurer l’environnement Databricks.

- Centraliser les données dans le Lakehouse.

- Entraîner ou importer un modèle.

- Déployer via MLflow.

- Monitorer et gouverner.

Analyse détaillée

Databricks est particulièrement adapté aux organisations souhaitant bâtir une stratégie IA durable et data-driven. Sa force réside dans l’unification des données et des modèles, au prix d’une complexité et d’un coût adaptés à des environnements entreprise.

Fonctionnalités & Cas d’usage

- Lakehouse unifié — Data + ML + IA.

- MLOps natif — Entraînement, déploiement, monitoring.

- Support LLM — Modèles open-source et intégrations partenaires.

- Gouvernance des données — Sécurité et conformité.

- Scalabilité cloud — AWS, Azure, GCP.

- LLM data-centric — Fine-tuning sur données internes.

- IA entreprise — Cas critiques et réglementés.

- Pipelines data & ML — Orchestration complète.

- Analytics + IA — Unification des usages.

Intégrations

- Apache Spark

- MLflow

- Cloud providers

- Frameworks ML / LLM

Screenshots

Tarification

- Entreprise : Tarification selon usage et services.

Avantages & Limites

👍 Avantages

- Unification data + IA

- MLOps mature

- Très forte adoption entreprise

👎 Limites

- Complexité élevée

- Coût entreprise

Alternatives

- AWS SageMaker

- Google Vertex AI

- Azure Machine Learning

🔍 Outils similaires

Anyscale

Plateforme MLOps et compute distribuée basée sur Ray pour entraîner, servir et scaler des workloads IA et LLM.

Baseten

Plateforme d’infrastructure permettant de déployer, servir et scaler des modèles ML et LLM en production.

AWS SageMaker

Plateforme MLOps complète d’AWS pour entraîner, déployer et gérer des modèles ML et LLM à l’échelle.

Google Vertex AI

Plateforme MLOps unifiée de Google Cloud pour entraîner, déployer et gérer des modèles ML et LLM.

Azure Machine Learning

Plateforme MLOps de Microsoft Azure pour entraîner, déployer et gouverner des modèles ML et LLM.

LlamaIndex

Framework open-source pour connecter des données privées aux modèles de langage via des pipelines RAG.