AWS SageMaker

Plateforme MLOps complète d’AWS pour entraîner, déployer et gérer des modèles ML et LLM à l’échelle.

En 2024–2025, SageMaker est largement utilisée par des entreprises souhaitant industrialiser des projets IA à grande échelle avec des exigences élevées en matière de sécurité, de gouvernance et de conformité.

Comment utiliser AWS SageMaker ?

- Configurer l’environnement AWS.

- Préparer les données dans S3.

- Entraîner ou importer un modèle.

- Déployer un endpoint SageMaker.

- Monitorer et scaler.

Analyse détaillée

AWS SageMaker est une solution robuste et complète pour les organisations cherchant une plateforme MLOps standardisée et sécurisée. Sa puissance et son intégration profonde avec AWS s’accompagnent toutefois d’une complexité et de coûts plus élevés.

Fonctionnalités & Cas d’usage

- MLOps end-to-end — Entraînement, déploiement, monitoring.

- Support LLM — Modèles open-source et services AWS.

- Infrastructure managée — Compute CPU/GPU/Trainium.

- Gouvernance & sécurité — IAM, audit, conformité.

- Scalabilité AWS — Niveau entreprise.

- Déploiement LLM en production — Applications critiques.

- Entraînement ML/LLM — Modèles à grande échelle.

- Pipelines MLOps — Automatisation complète.

- IA réglementée — Finance, santé, industrie.

Intégrations

- AWS S3

- AWS IAM

- AWS Bedrock

- Frameworks ML / LLM

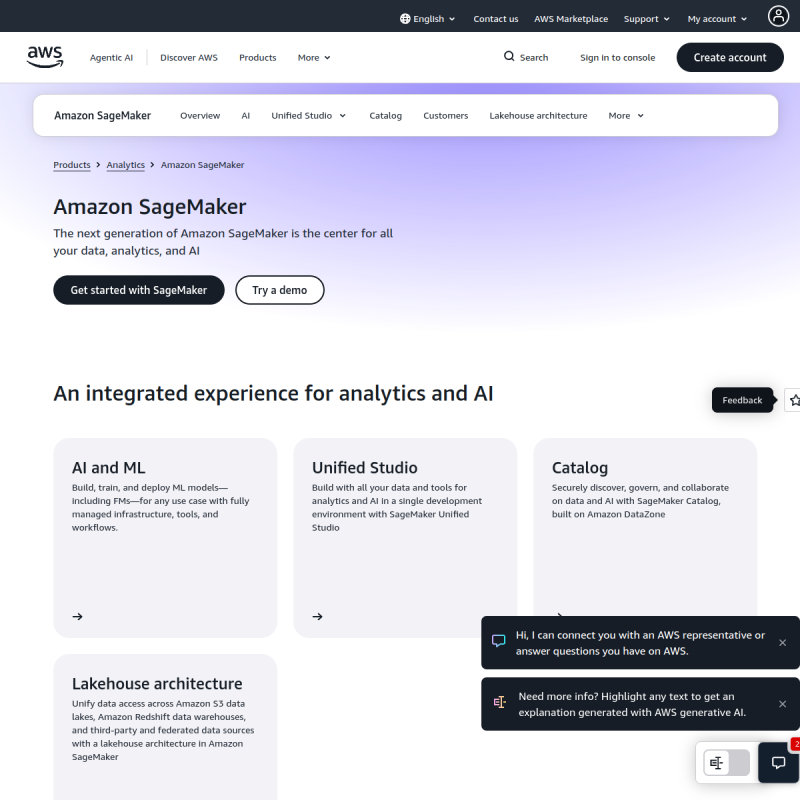

Screenshots

Tarification

- Pay-as-you-go : Facturation selon ressources utilisées.

Avantages & Limites

👍 Avantages

- Plateforme MLOps complète

- Sécurité et conformité AWS

- Très scalable

👎 Limites

- Complexité élevée

- Coûts AWS à maîtriser

Alternatives

- Google Vertex AI

- Azure Machine Learning

- Databricks

🔍 Outils similaires

Google Vertex AI

Plateforme MLOps unifiée de Google Cloud pour entraîner, déployer et gérer des modèles ML et LLM.

Azure Machine Learning

Plateforme MLOps de Microsoft Azure pour entraîner, déployer et gouverner des modèles ML et LLM.

Together AI

Plateforme cloud permettant l’inférence et le fine-tuning de modèles de langage open-source à grande échelle.

Replicate

Plateforme permettant d’exécuter et de déployer des modèles de machine learning et de LLM via une API simple.

Fireworks AI

Plateforme d’inférence LLM haute performance axée sur la vitesse, la fiabilité et le contrôle des coûts.

Anyscale

Plateforme MLOps et compute distribuée basée sur Ray pour entraîner, servir et scaler des workloads IA et LLM.