DSPy

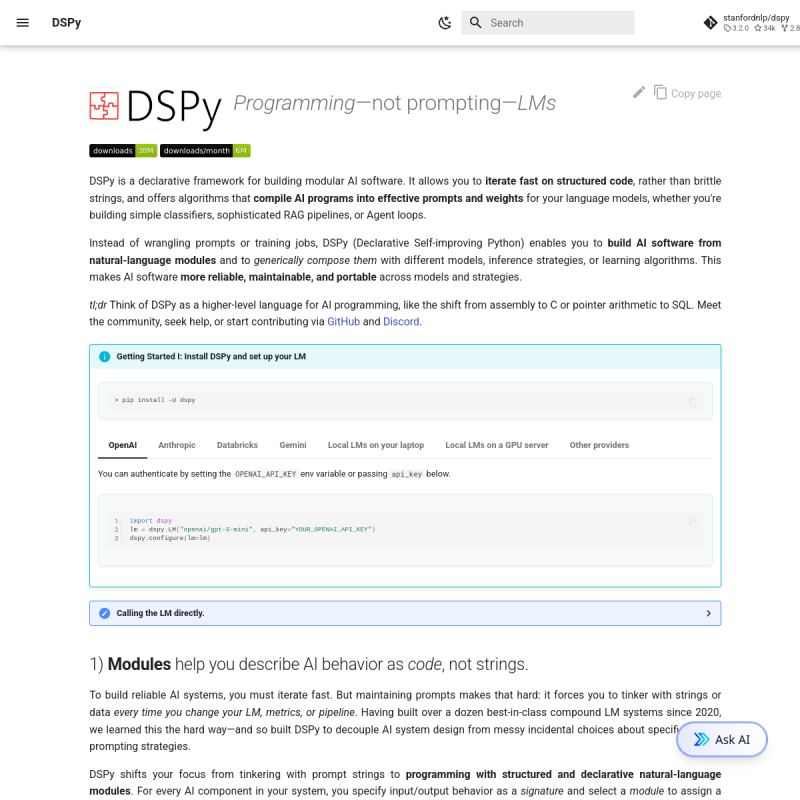

Framework open-source pour programmer, optimiser et évaluer des systèmes LLM sans dépendre du prompt engineering manuel.

DSPy permet de séparer la logique métier de la stratégie d’interaction avec le LLM. Le framework compile et ajuste les prompts, instructions et démonstrations en fonction des données et des métriques définies, ce qui améliore la robustesse, la reproductibilité et la performance des systèmes. En 2024–2025, DSPy est de plus en plus utilisé pour des pipelines RAG, des agents et des tâches complexes nécessitant une optimisation continue.

Comment utiliser DSPy ?

- Installer DSPy via pip.

- Définir les signatures et objectifs.

- Connecter le modèle de langage.

- Lancer l’optimisation automatique.

- Évaluer et itérer.

Analyse détaillée

DSPy représente une évolution importante dans la manière de concevoir des systèmes LLM robustes. En réduisant la dépendance au prompt engineering artisanal, il améliore la reproductibilité et la qualité globale. Il s’adresse principalement à des profils techniques et nécessite une compréhension claire des objectifs et métriques pour délivrer tout son potentiel.

Fonctionnalités & Cas d’usage

- Programmation déclarative LLM — Définition d’objectifs plutôt que de prompts fixes.

- Optimisation automatique — Ajustement des instructions et démonstrations.

- Réduction du prompt engineering manuel — Moins d’itérations empiriques.

- Métriques intégrées — Optimisation guidée par la qualité mesurée.

- Support RAG — Intégration avec retrieval et contextes.

- Composabilité — Modules réutilisables et chaînables.

- Open-source — Transparence et extensibilité.

- Systèmes RAG — Optimiser la qualité des réponses.

- Agents IA — Améliorer la fiabilité des comportements.

- Recherche appliquée — Expérimentation reproductible.

- Produits SaaS IA — Réduction des régressions.

- LLMOps — Standardisation des optimisations.

Intégrations

- Python

- LLM providers (OpenAI, Anthropic, etc.)

- Vector databases

- Pipelines RAG

Screenshots

Tarification

- Open-source : Gratuit et libre d’utilisation.

Avantages & Limites

👍 Avantages

- Réduction drastique du prompt engineering

- Approche scientifique et reproductible

- Très pertinent pour RAG et agents

👎 Limites

- Courbe d’apprentissage conceptuelle

- Orienté développeurs avancés

Alternatives

- LangChain

- LlamaIndex

- Promptfoo

🔍 Outils similaires

Langfuse

Plateforme open-source d’observabilité, d’analytique et d’évaluation pour applications et agents basés sur des LLM.

Flowise

Plateforme open-source no-code permettant de créer des workflows LLM, chatbots et agents IA via une interface visuelle.

DeepEval

Framework open-source pour évaluer, tester et fiabiliser des applications LLM, agents et pipelines RAG.

LlamaIndex

Framework open-source pour connecter des données privées aux modèles de langage via des pipelines RAG.

Haystack

Framework open-source pour construire des systèmes de recherche sémantique, QA et RAG basés sur des LLM.

AutoGen

Framework open-source de Microsoft pour créer et orchestrer des systèmes multi-agents basés sur des modèles de langage.